स्पेशल रिपोर्ट: OpenAI ने ChatGPT में Teen-Safety Features लॉन्च करेगा

“भविष्य में ChatGPT इस्तेमाल करने के लिए आपकी पहचान (Identity) वेरिफाई करनी पड़ सकती है।” यह कहना है OpenAI के CEO सैम ऑल्टमैन का। उन्होंने हाल ही में यह बड़ा बयान दिया और साथ ही कंपनी ने कुछ नए फीचर्स भी लॉन्च किए हैं जो खासकर माइनर्स (किशोरों) की सुरक्षा को ध्यान में रखकर बनाए गए हैं।

क्यों ज़रूरी हुए ये Safety Features?

पिछले कुछ महीनों में दुनिया भर से ऐसे कई केस सामने आए, जहां बच्चों और किशोरों ने AI चैटबॉट्स पर बहुत अधिक भरोसा कर लिया। अमेरिका और यूरोप से जुड़े कुछ सुसाइड केस ने सभी को हिला कर रख दिया। इन मामलों में परिवारों का कहना था कि उनके बच्चों ने अपनी भावनाएँ और दिक्कतें सिर्फ चैटबॉट के साथ शेयर कीं, और माता-पिता को आखिरी समय तक इसका अंदाज़ा भी नहीं हुआ।

इसके बाद FTC (Federal Trade Commission) ने भी जांच शुरू कर दी कि क्या कंपनियाँ बच्चों की सुरक्षा को लेकर पर्याप्त कदम उठा रही हैं या नहीं। इसी दबाव और ज़िम्मेदारी को देखते हुए OpenAI ने ChatGPT के लिए नए Teen-Safety Features पेश किए।

नए फीचर्स में क्या मिलेगा?

OpenAI ने ChatGPT में कई बदलाव किए हैं ताकि माइनर्स के लिए यह और सुरक्षित बने। इनमें मुख्य रूप से ये शामिल हैं:

- Age Prediction: ChatGPT अब अनुमान लगाएगा कि यूज़र नाबालिग है या नहीं।

- Identity Verification (भविष्य में): सैम ऑल्टमैन ने साफ कहा कि आने वाले समय में ChatGPT इस्तेमाल करने के लिए यूज़र्स को अपनी पहचान वेरिफाई करनी पड़ सकती है।

- Safe Mode: अगर कोई यूज़र माइनर निकला तो उसके लिए ChatGPT अधिक सुरक्षित और सीमित मोड में चलेगा।

सुसाइड केस और AI की जिम्मेदारी

AI चैटबॉट्स पर बढ़ती निर्भरता ने एक बड़ा सवाल खड़ा कर दिया है – “क्या मशीन इंसानों के भावनात्मक संकट को संभाल सकती है?” कई किशोरों ने अकेलेपन, तनाव और मानसिक दबाव में AI को ही अपना दोस्त बना लिया। लेकिन कई बार चैटबॉट्स के जवाब उनकी मानसिक स्थिति के लिए सही नहीं रहे।

यही वजह है कि अब कंपनियाँ यह मान रही हैं कि सिर्फ स्मार्ट चैटबॉट्स बनाना ही काफी नहीं, उन्हें सुरक्षित और जिम्मेदार भी बनाना होगा।

एक आम इंसान की नज़र से

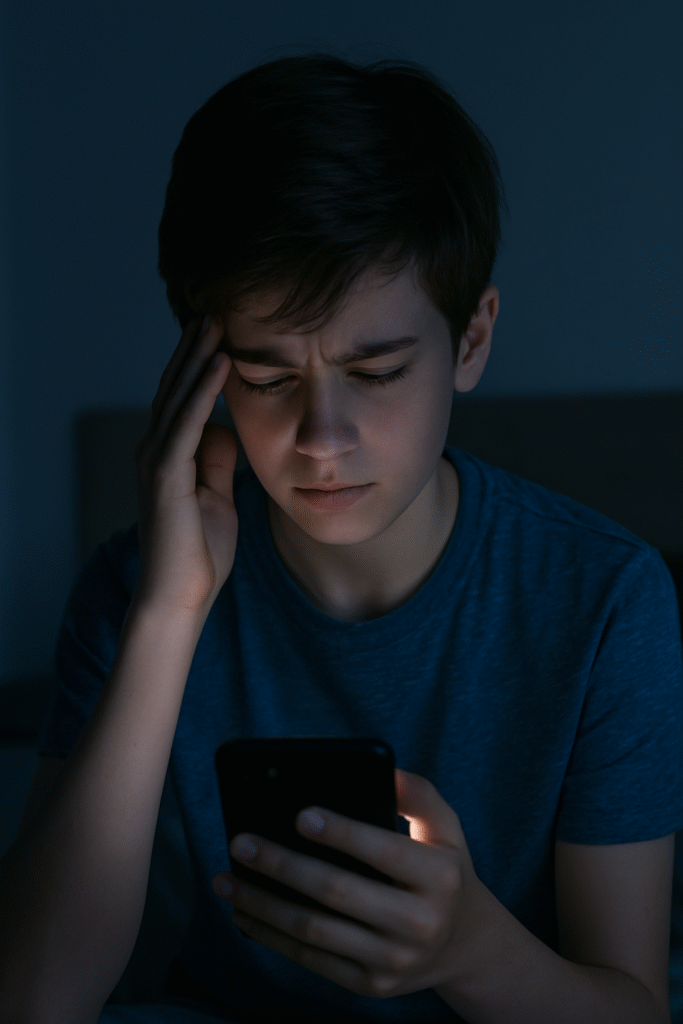

मान लीजिए आप एक पिता हैं और आपका बच्चा रात-भर मोबाइल पर ChatGPT से बातें कर रहा है। आप सोचते हैं – “ये तो पढ़ाई कर रहा होगा।” लेकिन असलियत में बच्चा अपनी टेंशन, डर और अकेलापन चैटबॉट से शेयर कर रहा है।

अगर ऐसे में AI को खुद ही यह समझ आ जाए कि सामने वाला बच्चा है, तो यह उसे सेफ़ और पॉज़िटिव दिशा में गाइड कर सकता है। यही OpenAI की इस नई पहल का सबसे बड़ा मकसद है।

भविष्य की दिशा

AI कंपनियाँ अब तेजी से इस दिशा में काम कर रही हैं कि चैटबॉट्स बच्चों के लिए हानिकारक न बनें। सैम ऑल्टमैन ने कहा कि आने वाले समय में identity verification केवल एक विकल्प नहीं, बल्कि ज़रूरी हिस्सा हो सकता है। इसका मतलब यह है कि हर यूज़र को अपनी उम्र और पहचान साबित करनी होगी ताकि सिस्टम यह तय कर सके कि उसके लिए कौन-सा वर्ज़न सुरक्षित है।

AI और समाज

तकनीक हमेशा दोधारी तलवार रही है। एक तरफ AI चैटबॉट्स लोगों को मदद, जानकारी और सहारा दे रहे हैं। दूसरी तरफ अगर इनका गलत इस्तेमाल हुआ या इन्हें सही गाइडलाइन के बिना छोड़ा गया तो यह गंभीर नतीजे ला सकते हैं।

OpenAI का यह कदम दिखाता है कि टेक कंपनियाँ अब केवल इनोवेशन पर नहीं, बल्कि जिम्मेदारी पर भी ध्यान दे रही हैं।

भारत में असर

भारत जैसे देश में, जहां इंटरनेट यूज़र्स की संख्या करोड़ों में है और युवा आबादी बहुत बड़ी है, ऐसे फीचर्स और भी महत्वपूर्ण हो जाते हैं। यहां कई बच्चे स्मार्टफोन और AI ऐप्स का उपयोग बिना किसी गाइडेंस के करते हैं। ऐसे में अगर सिस्टम खुद ही उम्र पहचान सके और बच्चों के लिए सुरक्षित मोड ऑन कर दे, तो यह परिवारों और समाज दोनों के लिए राहत की बात होगी।

निष्कर्ष

OpenAI का यह नया कदम दिखाता है कि AI अब सिर्फ स्मार्ट असिस्टेंट नहीं, बल्कि जिम्मेदार साथी भी बन सकता है। सैम ऑल्टमैन के अनुसार, भविष्य में ChatGPT इस्तेमाल करने के लिए आइडेंटिटी वेरिफिकेशन ज़रूरी हो सकता है, ताकि बच्चों और किशोरों की सुरक्षा सुनिश्चित की जा सके।

दुनिया तेजी से बदल रही है और तकनीक हमारे जीवन का बड़ा हिस्सा बन रही है। ऐसे में सुरक्षा और जिम्मेदारी को प्राथमिकता देना समय की सबसे बड़ी मांग है। OpenAI की यह पहल इसी दिशा में एक मजबूत कदम है।